AHs2026でデモ/ポスター発表を行いました(M2國枝・土川・B4福田・牧野)

M2の國枝です. 沖縄のOIST(沖縄科学技術大学院大学)で2026年3月16日から3月19日にかけて開催された国際会議「AHs2026 (The Augmented Humans International Conference 2026) 」でM2の國枝,土川,B4の福田がデモ発表,B4の牧野がポスター発表を行いました.

AHs2026では,日本開催というのもあり,想像していたよりも日本人参加者が多く,日本語と英語の両方を使い分けながら議論できたのが印象的でした. 海外の参加者の方々と英語で話しつつ,日本人研究者の方々とはより踏み込んだ内容まで議論することができ,とても密度の高い時間になりました.

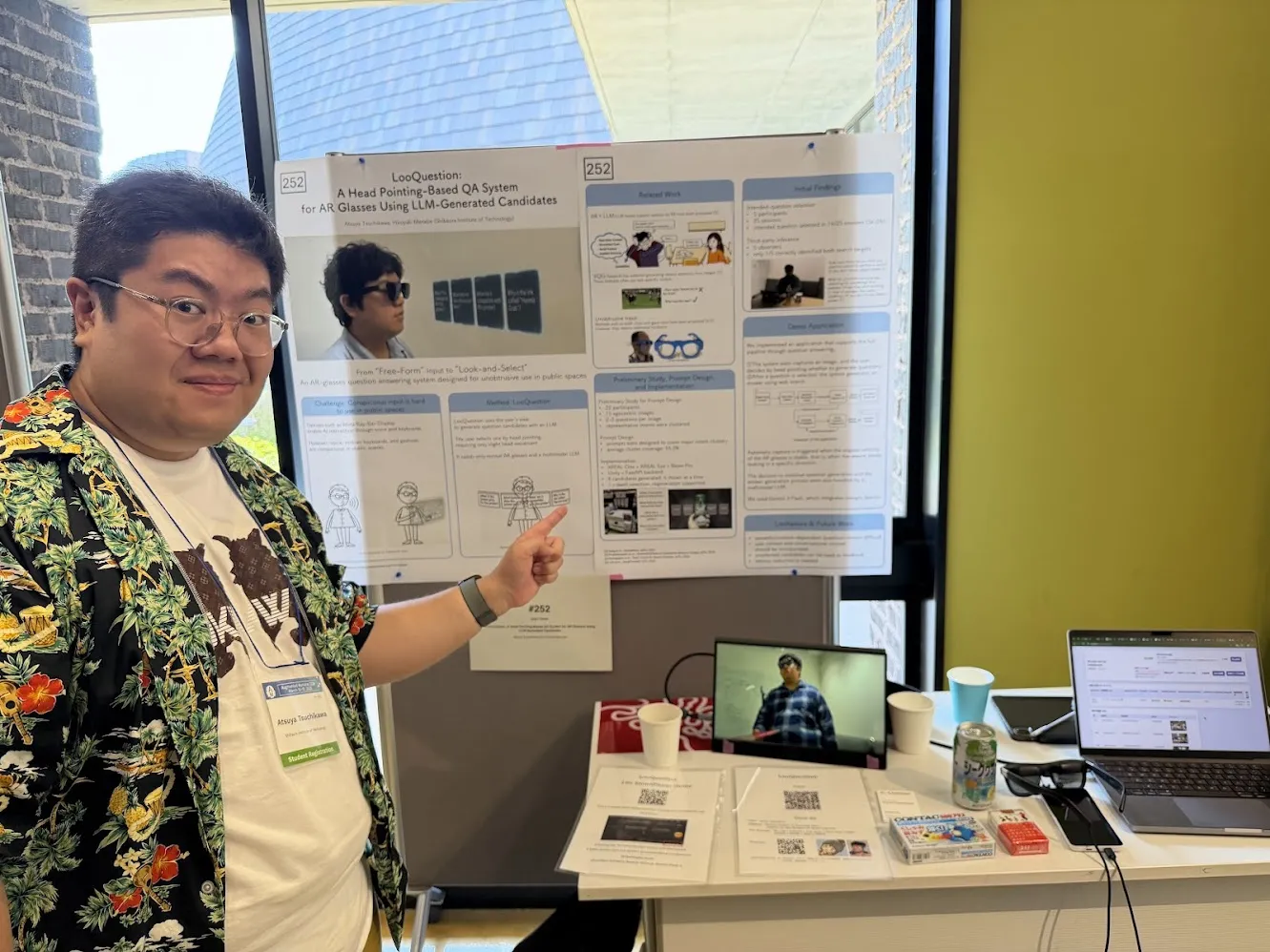

発表日程としては,2日目に私と牧野君,3日目に福田君と土川君がそれぞれ発表を行いました. 私は片手首にIMUデバイスを着けて全身をタップ入力デバイスに変える手法,牧野君は図面レビューにおいて入力手法がフィードバックに与える影響,福田君は寝転がった体勢で使えるVR向け入力手法,土川君は知りたい質問に頭を向けるだけでQ&AができるARグラス向けの入力手法について発表を行い,多くの方々と議論することができました.

私のデモ発表では,実際に身体をタップして操作する様子をその場で見てもらえたこともあり,多くの方に「面白い」と反応していただけました. 特に,単に認識精度の話にとどまらず,「これをどんな場面で使えるのか」「どのような応用先が考えられるのか」といった点に興味を持ってくださる方が多く,研究の広がりについて考える良い機会になりました.

また,発表以外の時間にも,他の方々の発表を見ることができ,大いに刺激を受けました. Augmented Humansらしい,人の能力や体験を広げる様々な研究が集まっており,自分たちの研究を今後どう発展させていくかを考えるうえでも非常に有意義な学会参加になりました.

おまけ

期間中は,発表だけでなく食事も楽しみの一つでした. 1日目のBanquetや2日目のOpenLabでは,沖縄らしい料理やさまざまな食べ物が用意されていました. Banquetでは海辺や夕日を見ながらの食事や交流を行い,OpenLabではOISTでの興味深い研究を見るなど楽しい時間を過ごすことができました. これらの時間は,セッション中とはまた違った雰囲気で,学会ならではの良さを感じました.

研究概要

Whole-Body Tap Interaction with a Single Wrist-Worn IMU(國枝)

スマートフォンやスマートウォッチにおけるタップ入力は有効であるものの,視覚的な注視とデバイスの操作を必要とすることが多く,日常活動の中で不便を感じる場面が少なくない.本研究では,推論時にカメラや追加の装着型センサを必要とせず,手首に装着した単一のIMUのみを使用する全身タップ位置検出技術を提案する.本手法は,タップ直前の手首の運動とタップによる振動の周波数情報を同時に活用し,軽量な1次元CNNモデルによってタップ状態と位置情報を分類する.オフライン実験(被験者数:6名)では,同一被験者内評価(10分割クロスバリデーション)と被験者間評価(LOSO)を実施し,さらにターゲット位置数を調整することで実用的な空間分解能を推定した.その結果,右手でのタップ操作は左手に比べて頑健性が高く,左手はターゲット位置数が増えるにつれて精度が低下することが明らかになった.リアルタイムテスト実験(被験者数:2名,パーソナライズ)では,歩行時や連続的なタップ操作において顕著な性能低下が確認された.最後に,カメラレス全身タップ入力を実現可能な実用的な手法として,3つのアプリケーション例(視線非依存型音楽プレイヤー,柔軟なスライダー制御,およびシューティングゲーム)を実証する.これらの結果から,移動環境下での頑健性と被験者間汎化性能が今後の重要な課題であることが示された.

How Input Methods Augment Feedback in Engineering Drawing Review(牧野)

工学図面レビューの実務において,印刷された図面への注釈は対面での議論と組み合わせられることが一般的である.分散型コラボレーションやデジタルトランスフォーメーションを支援するためには,非同期的な図面レビューが必要となるが,単に注釈だけではその理由付けや背景知識を効果的に伝達できない場合が多い.本研究では,非同期図面レビューにおける手段として入力手法に着目し,2つの実験を通じてフィードバックがどのように増強されるかを検討した.得られた結果から,効果的な表現方法はレビュー対象となる誤りの種類によって異なること,また,レビュアーが採用する入力手法はその個人のレビュースタイルに強く影響されることが明らかとなった.これらの知見は,選択可能な入力手法を通じてレビュアーが意図や理由付けをより明示的に外部化できるようにすることで,図面レビュープロセスを改善できる可能性を示している.

Posture-Aware Input for VR Office Work in a Supine Position(福田)

仮想現実(VR)は,生産性を重視した作業環境としての可能性を秘めているものの,長時間にわたる使用は身体的負担や姿勢上の制約によって制限される.仰臥位での姿勢は首や肩にかかる負担を軽減できる一方,頭部の動きを制限するため,マルチウィンドウ構成のVRワークスペースにおける継続的な操作が困難になるという課題がある.本研究では,仰臥位でのVRオフィス作業向けに,視線ベースのポインティングと身体に装着するキーボードを統合した姿勢適応型入力インターフェースを提案する.この設計により,頭部の回転動作や空中での腕の動きを必要とすることなく,連続的な視点回転・ポインティング・テキスト入力が可能となり,使用者は安定した身体体勢を維持できる.ユーザスタディの結果,本手法が切り替え遅延の低減,視点回転を伴う作業条件におけるタスク完了時間の短縮,およびベースライン手法と比較して主観的負荷の軽減をもたらすことが確認できた.さらに,この技術を応用した2つのアプリケーションを通じて,仰臥位VR環境における継続的な操作の実現例を示す.これらの結果は,VRインタラクション設計において,身体体勢を考慮することを第一級の制約条件として扱う必要性を明確に示している.

LooQuestion: A Head Pointing-Based QA System for AR Glasses Using LLM-Generated Candidates(土川)

ARグラスを使用してAIアシスタントに周囲環境について質問したい場合,音声入力や空中ジェスチャーといった従来の操作方法は,公共の場では目立ちやすく,好ましくない場面が多い.本論文では,明示的なユーザー入力に依存することなく非侵入的に質問が可能な,ARグラス向けAIアシスタントとのインタラクション手法「LooseQuestion」を提案する.本システムはマルチモーダルLLMを活用し,自己視点画像から質問候補を生成する.ユーザーはARビューに表示された複数の質問選択肢の中から,頭部を用いたポインティング操作によって選択を行う.効果的なプロンプトを設計するため,我々は22名の参加者に対して自己視点画像を提示した際の発話内容を収集し,それらをクラスタリングして共通する質問タイプを明らかにした.追加のタスク特化型ファインチューニングを行わなくても,生成された質問候補は平均的に人間による質問群の55.0%を網羅していた.さらに,第三者が操作の有無や内容を推測できるかを検証した評価実験では,質問のタイミングや検索対象を正確に特定できたのは参加者の20%に留まり,周囲から見て極めて目立ちにくいことが実証された.UnityとFastAPIを用いてXREAL Oneデバイス上に実装した本システムでは,一度に4つの候補を表示可能で,再生成機能もサポートしている.実験結果から,テキスト入力や追加ハードウェアを必要としない選択型インタラクションアプローチが,AIアシスタントに対する非侵入的で社会的に受け入れやすい質問方法を実現し,AR環境における状況に応じた人間の問い掛けをより効果的に支援できる可能性が示された.