インタラクション2026にてインタラクティブ発表を行いました(M2土川・B4佐藤)

M2の土川です. 2026年3月3日~3月5日に学術総合センター内 一橋記念講堂で開催されたインタラクション2026に,M2の土川とB4の佐藤が参加し,それぞれインタラクティブ発表を行いました.

発表中は他大学の学生や先生方,企業の方々から多くの意見をいただき,自分たちの研究を別の視点から見直すよい機会になりました. 近くのデモ・ポスター発表を見るだけでも,ARグラスやVR,入力インタフェース,生成AIを用いた研究など,幅広い研究に触れることができました.

一方で,私は当日39度を超える熱があり,自分の発表がある1日目のみの参加となりました. 近くの発表を見ることはできたものの,会場全体をじっくり見て回れなかったことが心残りです. 翌日にはインフルエンザと診断され,せっかく発表を見に来てくださった方々にうつしていないか心配にもなりました.

発表した内容は以下の通りです.

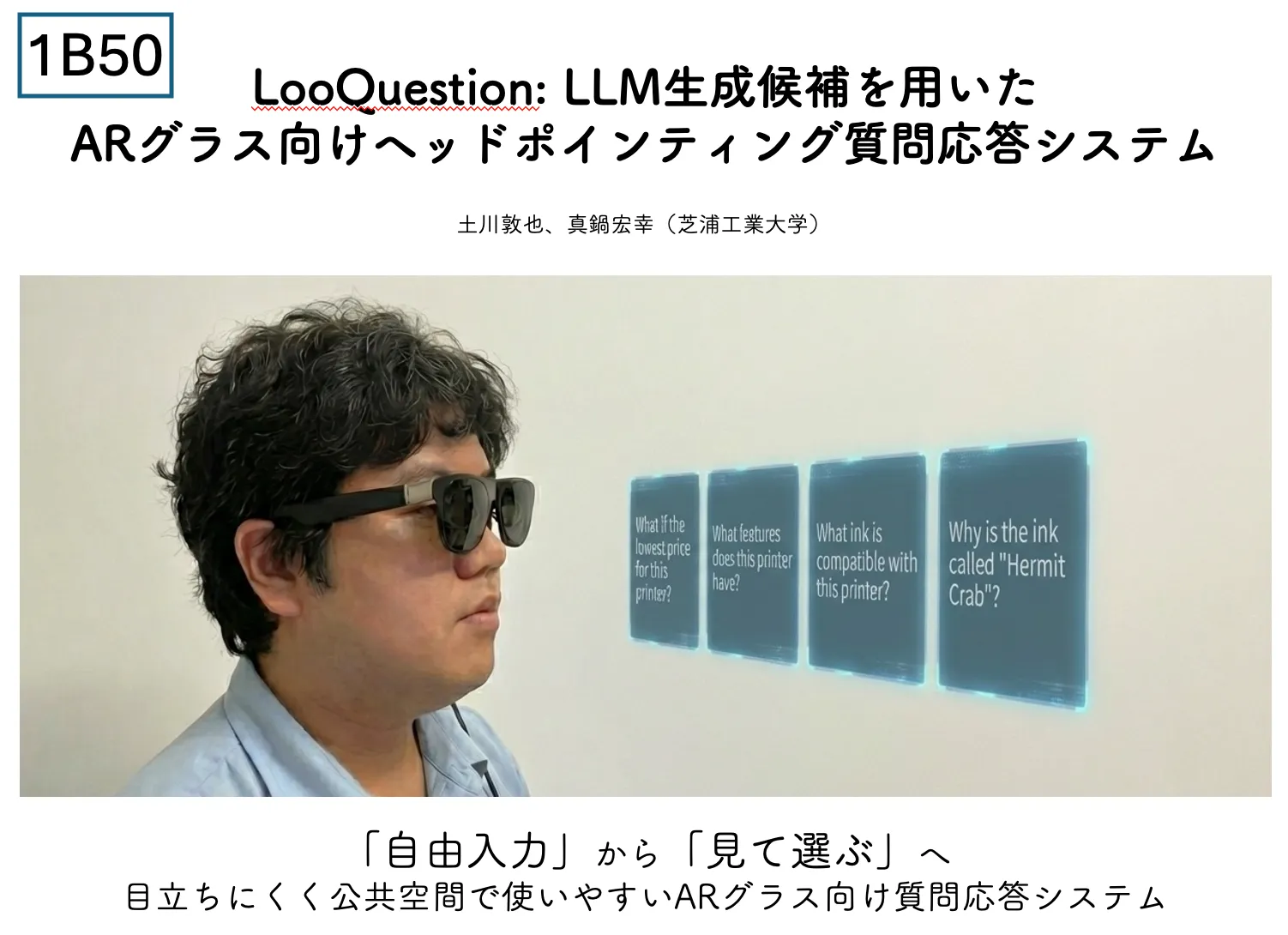

- 土川 敦也, 真鍋 宏幸, “LooQuestion: LLM生成候補を用いたARグラス向けヘッドポインティング質問応答システム”, インタラクション2026予稿集, 1B-50, pp. 348-351, 2026.

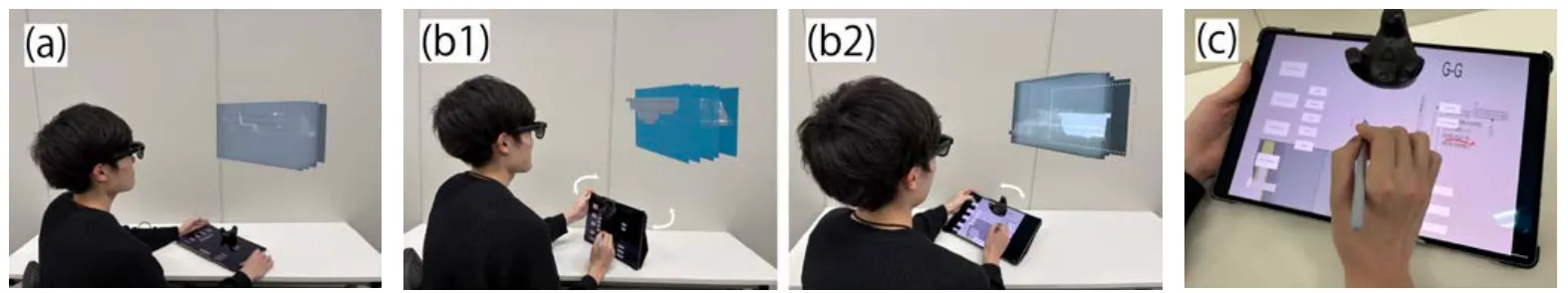

- 佐藤 翼, 真鍋 宏幸, “AR/VR環境における3Dオブジェクトの素早い断面選択を実現する操作手法”, インタラクション2026予稿集, 2A-13, pp. 585-587, 2026.

インタラクション2026のプログラムにも掲載されています.

研究概要

LooQuestion: LLM生成候補を用いたARグラス向けヘッドポインティング質問応答システム(土川)

ARグラスで周囲の情報についてAIアシスタントに質問する場合,音声入力や空中ジェスチャは公共空間で目立ちやすく,利用しづらい場面があります. 本研究では,ARグラスのカメラで取得した視点画像をもとにLLMが質問候補を生成し,ユーザが候補から選択することで質問を行うLooQuestionを提案しました. ユーザはAR表示された候補をヘッドポインティングで選択するため,文字入力や大きな手の動きを使わずにAIアシスタントへ質問できます. 実装ではXREAL One/Eye/Beam ProとUnity,FastAPIを用いて,質問候補の提示と追加生成を行えるシステムを構築しました.

AR/VR環境における3Dオブジェクトの素早い断面選択を実現する操作手法(佐藤)

製造業の検図作業を3D CADやAR/VRへ移行する際には,複数の断面から目的の断面を素早く正確に選ぶ操作が重要になります. 既存のリスト選択では断面の空間的な関係を把握しづらく,3Dオブジェクト上で直接選択する方法では視点操作が多くなる課題があります. 本研究では,ARグラスで3Dモデルと断面位置を確認しながら,タブレットの傾きによって断面を選択する操作手法を提案しました. タブレットを使うことで,手書きでの書き込みと物理的な操作感を保ちつつ,スナップや傾き入力によって素早い断面選択を目指しています.

終わりに

今回の発表では,実装や評価の進め方,利用場面の広げ方について多くのコメントをいただきました. いただいた意見を今後の研究に活かし,より使いやすいシステムを目指していきます.

おまけ(毎年恒例の豚大学)

弊研究室では,インタラクション参加後に「豚大学」という焼豚丼のお店に行くのが恒例となっています. 今年も参加メンバーで行ってきたようです.(私は今回行けませんでしたが,前に食べたときに非常に美味しかった記憶があります.)

写真だと分かりにくいですが,豚丼1kgはかなりの量で,食べきるのは大変です. ただ,これでも「大学院」というメニューで,更に上の1.5kgの「修士」や2kgの「博士」もあります.

食べ切れたようですね! でも,まだ「大学院」に入学した扱い. 弊学の「修士」を卒業する際には,是非豚大学の「修士」も食べきって豚大学修士号を取得してみて欲しいですね.